親族や公共機関の職員などになりすまし、あの手この手で相手から金銭をだまし取る特殊詐欺。AIが進化することで、今までにない詐欺の被害が警戒されている。

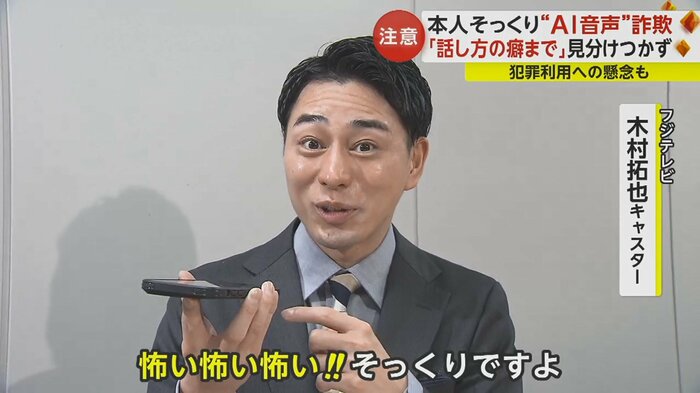

「怖い!話し方の癖まで似ている」

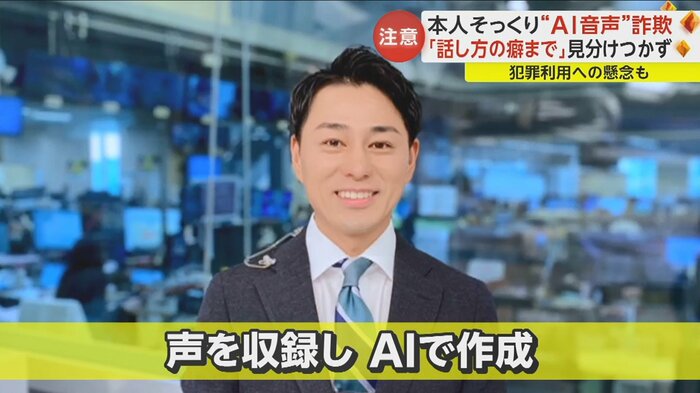

「もしもし、フジテレビアナウンサーの木村拓也と申します。よろしければ、お宅でぜひロケをさせていただきたいのですが、よろしいですか?」

自宅でのロケを申し入れる木村拓也キャスターの声。さらに、「ご協力いただける場合は、もちろん謝礼もお支払いします。一度、番組スタッフが伺いますので、住所を教えていただけますか?」と持ちかける。

実はこの音声は、木村キャスターの声を収録し、AI(人工知能)で作ったものだ。実際の声とAI音声を聞き比べても、ほとんど区別がつかない。

「怖い怖い怖い!!そっくりですよ。話し方の癖とかまで似てますし、ただちょっと音声の粗さとかは若干ありますけど、にぎやかなところからの電話なのかなと思ったら、そのままです」と、木村キャスター本人もAIで作られた偽の音声に驚きを隠せない。

被害に遭わないための対策は

さらに、AIを使うことで、事故を装ったオレオレ詐欺の音声も作ることができてしまう。

こうした偽の音声の被害に遭わないための対策として、日本はもちろん、海外からの怪しい電話番号を識別できるアプリも登場していて、これまでに1億件以上ダウンロードされている。

新手のAI詐欺について、ITジャーナリストの三上洋さんは、「聞いた印象としては、とても良くできています。なかなかこれをAIと判別するのは難しいと思います。ただ、よく聞くと若干イントネーションがおかしいところがあります」と指摘する。

お互いにしかわからない合言葉を事前に決めておくことや、着信があってもいきなりは出ず、留守番電話を活用することが重要だとしている。

(「イット!」12月28日放送より)