災害が起きると、人々は不安の中で情報を求める。しかしその中には生成AIによって作られたフェイク動画や画像が紛れ込んでいるかもしれない。

災害時に人を惑わす「AIフェイク映像」という新たなリスクと対策について、国際大学の山口真一准教授に聞いた。

誤情報は深刻な混乱を招く

災害時は情報の需要が高まり、フェイク情報が拡散されやすくなる。

山口准教授は、生成AIによるニセ映像が広まると、実際には起きていない建物の倒壊や津波の映像により、住民が誤った避難行動を取るなど「二次被害」につながる恐れがあると指摘する。

一つの誤情報が社会的混乱を引き起こすリスクは非常に高い。

災害情報は必ずファクトチェックを

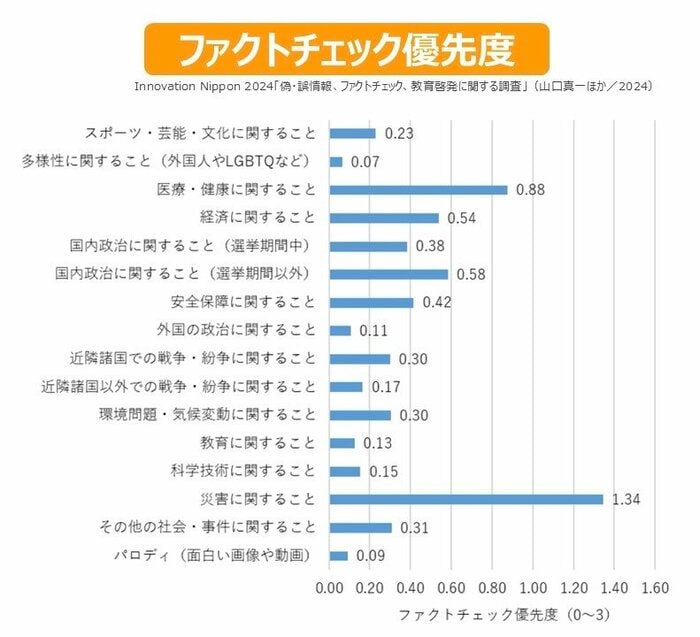

どのカテゴリーの情報が優先的にファクトチェックされるべきかを問うアンケートでは、「災害に関すること」が1位だった。

避難や支援の判断に直結するため非常に重要な情報だが、緊急時には冷静な判断も難しく、AIによる誤情報を見抜くのは容易ではない。

山口准教授によると、AIで生成された巧妙な映像であっても、基本的な確認を積み重ねることで、自分である程度のファクトチェックをすることは可能だそうだ。以下、3つのポイントを教えていただいた。

ファクトチェックのポイント3選

(1)情報の出所を探る

情報の信頼性を判断するには、「出所の確認」が不可欠。公的機関や報道機関が発信する情報は、精度が高い傾向がある。

一方、匿名アカウントの投稿は信頼性が低く、過去の投稿履歴などの検証が必要となる。

(2)違和感を見逃さない

生成AI映像にも欠点がある。細部に“不自然さ”が残ることが多いのだ。

人物の動きがぎこちない、影や光の向きが一致しない、背景がぼやけているなど、違和感のあるポイントは見逃さないよう注意が必要だ。

(3)“逆検索”が効果的

画像検索や検証ツールを使った「逆検索」もファクトチェックに有効だ。

動画の場合は一部を切り出した画像を検索することで、過去の災害映像の流用などを見抜ける場合がある。

他にも、逆検索をすることで映像内の看板、車のナンバー、天気などを報道や公式発表と照らし合わせることもできる。

その結果、現地の状況と明らかに異なる点があれば、動画や画像のインパクトに惑わされず、冷静に疑うべきである。

複数の情報源活用も有効

AIによって生成された“リアルすぎる災害映像”がSNSで拡散されるケースは増加している。誤情報と気づかずに共有されるリスクは高まっている。

山口准教授は、『SNSや動画配信サービスが活発化している現代だからこそ、閲覧数や反応獲得のために、より刺激的で不安をあおるような映像が生み出されやすい「アテンション・エコノミー」の構造がある』『災害時においては一つの情報源に依存せずに複数の信頼できる情報を照合する姿勢が重要』と指摘する。

災害時であっても、目にした情報を即座に信じるのではなく、立ち止まってファクトチェックを行う習慣が求められている。

【取材協力】国際大学・山口真一准教授

【参考文献】山口真一ほか(2024)「Innovation Nippon 2024 偽・誤情報、ファクトチェック、教育啓発に関する調査研究」

(執筆:フジテレビ気象センター・岡部茉莉)