困った時などに笑ってごまかそうとする「作り笑い」。これをAIで見抜いてしまう研究が発表され、注目を集めている。

慶應義塾大学大学院理工学研究科杉本研究室とNTTコミュニケーション科学基礎研究所柏野多様脳特別研究室による研究チームが、作り笑いをメガネ型デバイスとAIを使って識別したところ、人間よりも高い精度で判定できたというのだ。

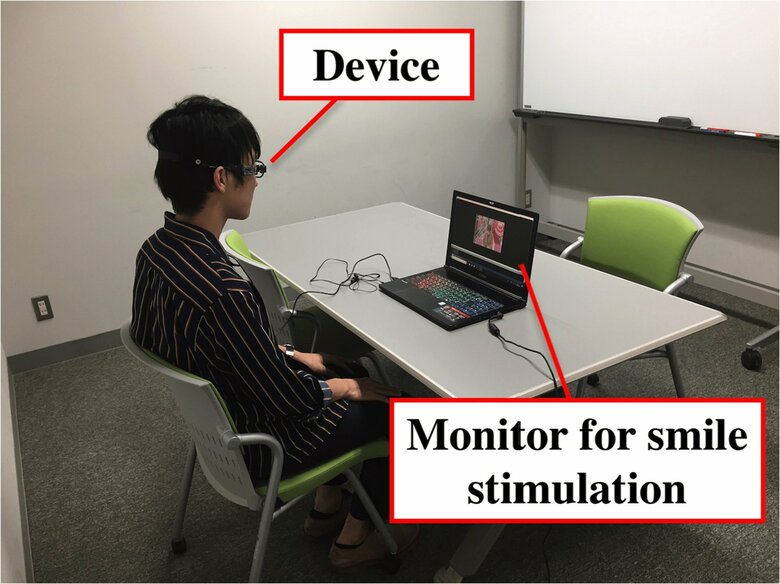

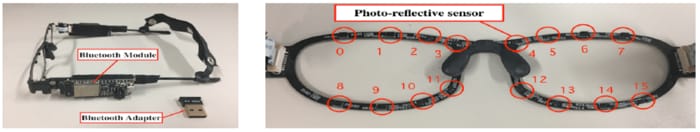

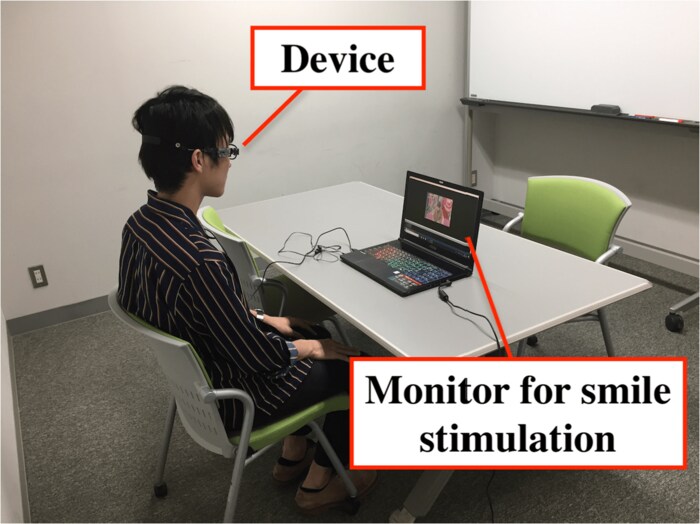

実験には21~25歳の男女12人が参加。16個の反射型光センサを取り付けたメガネ型デバイスを着用し、表情筋の動きなどからその変化を計測した。

参加者はパソコンのモニターと向き合い、この画面に「Smile」と笑う指示やお笑い番組の動画を表示し、実験を行った。

こうして、指示による「作り笑い」と、お笑い番組を見せたときの「自然な笑い」のデータを1人につき20回分を収集。これを元に、AIと13人の人間が「作り笑い」か「自然な笑い」かを判定した。(実験参加者と判定者は一部重複)

その結果、人間が静止画を見て「作り笑い」を判定した識別率は平均71.5%、動画を見た場合は90.2%だった。一方でAIは、16個のセンサの変位と、笑い始めてから最も大きく笑うまでの時間(時間的特徴)のデータを組み合わせると94.6%の精度で識別。人間よりも見分けることができたという結果になった。

メガネ型デバイスが必要とはいえ、AIが作り笑いを見抜くとは驚く人も多いのではないだろうか。ところで、なぜそもそも「作り笑い」を見抜く装置を作ろうと考えたのか?また、どんな使い道があるのか?

研究論文の筆頭著者である齊藤千紗さんに聞いてみた。

「作り笑い」は目と口が同時に動く

――AIで「作り笑い」を見抜こうと思ったきっかけは?

将来のコンピュータやAIが、ユーザの心に寄り添った支援を行っていく上では、ユーザの感情を適切に理解している必要があります。

これまでの研究としてウェアラブルデバイスを活用して、ユーザーの感情の表出である表情を識別する研究を行っていたのですが、その中で表情は本当に感情を反映しているのだろうか、私たちの笑顔には色々な感情が隠されているのではないかと考え始めたことが今回の研究のきっかけです。

――「作り笑い」と「自然な笑い」は何が違う?

作り笑いの場合、より大袈裟に(大きく)表情を変化させようとし、目と口が同時に動きますが、自然な笑いの場合、口が動いた後に目が動くというタイミングの違いがあるということが先行研究で示されています。

私たちの研究は、こうした特徴を眼鏡型のウェアラブルデバイスとデータ駆動型の機械学習によっても識別できることを示したものになります。

――「作り笑い」が上手な人と下手な人の違いは?

「作り笑い」と「自然な笑い」の識別には先述のような特徴が考慮できると考えられていますが、「作り笑い」が上手な人は、2つの笑いの間でこうした表情筋の動く大きさやタイミングが類似する様に笑顔を作れるのではないかと考えています。

――見抜く眼鏡型デバイスは、今後どんな使い道がある?

「作り笑い」と「自然な笑い」の割合を記録することによるストレスチェック、接客業などで自然な笑顔に近づけるための訓練やフィードバック、また色々な笑い方を識別することでエンターテイメントコンテンツの評価指標として応用できるのではないかと考えています。

ちなみに参加者が自然に笑えるように見せたのは、ある有名なテレビ番組だったそうだ。このシステムがあれば、お笑いコンテストなどでも、より正確なランキングがつけられるようになるかもしれない。